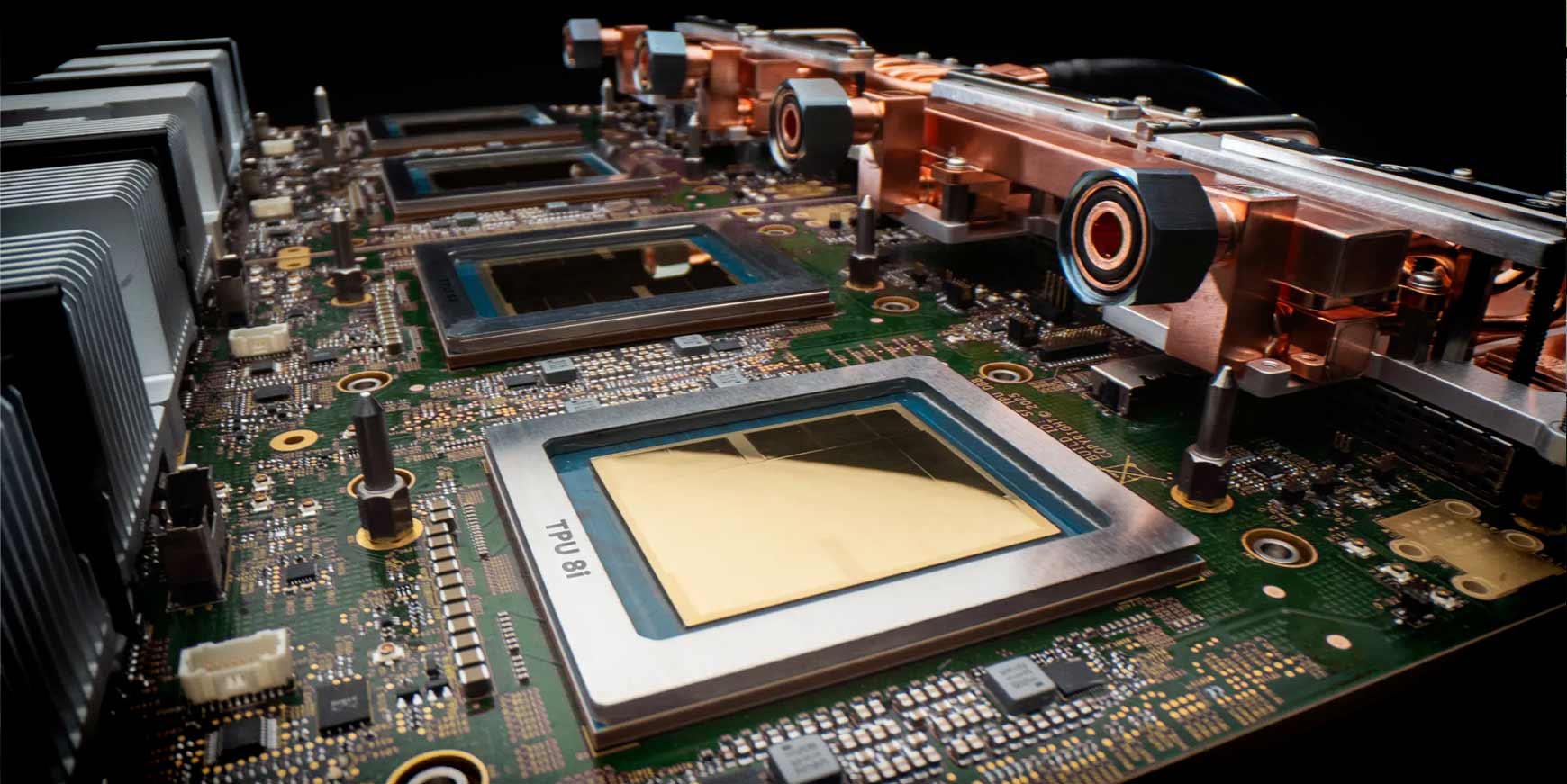

Google har skruet voldsomt op for ambitionerne på årets Cloud Next-konference. Her har selskabet præsenteret sin ottende generation af TPU-chips, altså de specialbyggede AI-processorer, som skal drive både træning af gigantiske modeller og de lynhurtige svar, vi møder i moderne AI-tjenester.

Den største opsigtsvækkende nyhed er TPU 8i, som er målrettet inference — altså den del, hvor AI’en skal svare, reagere og udføre opgaver i realtid. Ifølge Google leverer den op til 80 procent bedre performance per dollar end den forrige generation. Samtidig har chippen tre gange mere on-chip SRAM, hvilket skal gøre den bedre til store og krævende AI-modeller med lav ventetid.

Ved siden af den lancerer Google også TPU 8t, som er bygget til de helt tunge træningsopgaver. Her siger Google, at chippen kan levere op til 2,7 gange bedre performance per dollar til storskalatræning end Ironwood-generationen. Det er præcis den slags løft, der kan gøre en reel forskel for virksomheder, som træner store modeller og vil have mere regnekraft for pengene.

Begge chips er samtidig et forsøg på at gøre AI mindre strømslugende. Google siger, at TPU 8t og TPU 8i giver op til dobbelt så god performance per watt som forgængeren. Det er væsentligt i en tid, hvor AI ikke kun handler om rå styrke, men også om elregning, datacentre og kapacitet i stor skala.

Google går fra chatbot til agent

Chipnyheden står dog ikke alene. Google bruger også Cloud Next til at slå fast, at næste store AI-kamp ikke bare handler om modeller, men om agenter. Altså systemer, der ikke nøjes med at skrive tekst tilbage, men som kan arbejde på tværs af værktøjer, huske kontekst, hente data og udføre opgaver mere selvstændigt.

Derfor lancerer Google også Gemini Enterprise Agent Platform, som samler udvikling, drift, sikkerhed, evaluering og styring af AI-agenter i én samlet platform. Målet er at gøre det lettere for virksomheder at bygge agentløsninger, uden at hele projektet drukner i integrationer og kompleksitet.

Google lægger samtidig vægt på, at platformen ikke kun skal fungere med egne modeller. Dokumentationen viser, at den også understøtter partnermodeller, hvilket kan gøre løsningen mere interessant for virksomheder, der vil undgå at låse sig fast til ét enkelt AI-økosystem.

AI er ikke længere et eksperiment

Budskabet fra Google er i det hele taget, at virksomhedernes AI-brug er rykket videre fra pilotprojekter og testballoner. Selskabet fremhæver, at mange kunder nu bruger AI i reel drift, og hele lanceringen er tydeligt bygget op omkring, at AI skal være noget, der skaber resultater i praksis — ikke bare noget, der demonstreres i mødelokaler.

For almindelige brugere er det måske ikke TPU-navnene, der betyder mest her og nu. Men konsekvensen kan blive ret konkret: hurtigere AI-tjenester, mindre ventetid, mere avancerede funktioner og på sigt digitale assistenter, der kan klare langt mere selv end i dag. Det er den fremtid, Google nu forsøger at bygge infrastrukturen til.

De nye TPU 8t- og 8i-løsninger står som “coming soon” på Googles TPU-side, og selskabet siger, at de bliver tilgængelige senere i år